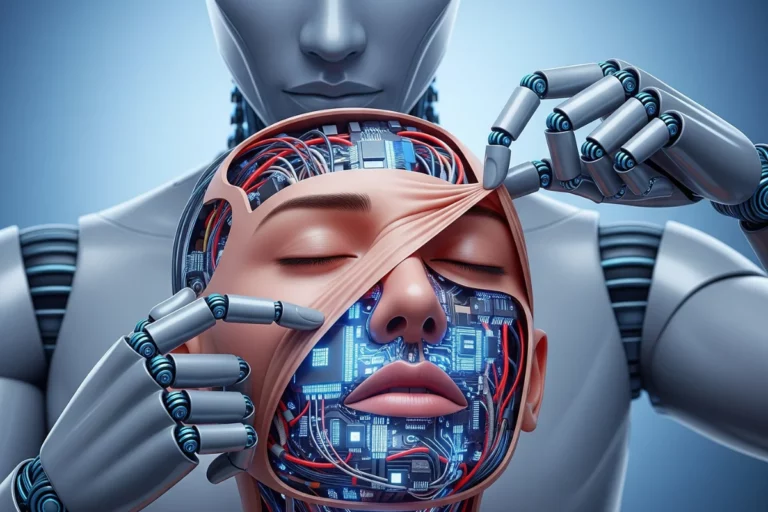

A inteligência artificial (IA) transformou a sociedade, tornando tarefas antes complexas mais rápidas e acessíveis em áreas como medicina, transporte e comunicação. Por trás desses avanços estão riscos e dilemas éticos que precisam ser considerados. Quanto mais a IA se integra ao cotidiano, maiores são também as consequências negativas dessa tecnologia. Além de oportunidades, a IA implica em desafios sociais, como desinformação, perda de privacidade, discriminação, ameaças à democracia e transformações profundas no mercado de trabalho. É indispensável um debate transparente para evitar que o uso indevido da inteligência artificial comprometa o progresso coletivo e perpetue desigualdades históricas.

🧩 1. Viés Algorítmico e Discriminação

Um grande risco é o viés algorítmico. Sistemas de IA são alimentados por grandes volumes de dados — e, infelizmente, esses dados frequentemente refletem preconceitos sociais e históricos. Como resultado, a IA pode amplificar desigualdades em vez de corrigi-las. Várias ferramentas já evidenciaram este problema ao favorecer determinados perfis e prejudicar minorias, especialmente em processos de seleção de emprego, concessão de crédito e julgamentos judiciais. Mesmo que a intenção dos desenvolvedores não seja discriminatória, é possível que resultados injustos surjam. Por isso, combater o viés algorítmico exige vigilância, atualização constante dos dados e uma abordagem interdisciplinar para correção e validação contínuas dos sistemas.

🎭 2. Deepfakes, Fakefaces e Clonagem de Voz

A IA generativa, capaz de criar fotos, vídeos e vozes realistas, expande a desinformação com deepfakes e fakefaces. Em 2025, diversos casos de manipulação atingiram políticos, celebridades e empresários — vídeos falsos foram usados para golpes, extorsões e manipulação de opinião pública. Clonagem de voz permite que criminosos simulem ligações e comandos autênticos, enganando até profissionais experientes. Diferenciar real de falso ficou tão difícil que a confiança em conteúdo audiovisual caiu drasticamente. Regulamentações existem, mas a velocidade das inovações ainda supera o controle. O cidadão precisa adotar uma postura crítica e buscar fontes confiáveis para se proteger desses riscos.

🧠 3. Dependência de IAs e Perda de Pensamento Crítico

Ferramentas como ChatGPT facilitaram a produção textual e de ideias. Porém, o excesso de delegação à IA pode prejudicar a criatividade, o desenvolvimento de argumentação própria e o senso crítico. No ambiente escolar e acadêmico, cresce o temor de que alunos se tornem meros consumidores de conteúdos genéricos, sem exercitar a pesquisa e a análise crítica de fontes. No cotidiano, a tendência é confiar tanto nas sugestões inteligentes que esquecemos de questionar, comparar ou buscar alternativas humanas. O grande desafio está em encontrar equilíbrio, estimulando habilidades cognitivas ao mesmo tempo em que se aproveitam os benefícios da automação.

🤖 4. Desemprego e Transformação do Mercado de Trabalho

A automação baseada em IA está reestruturando profundamente o mercado de trabalho, especialmente em áreas de tarefas repetitivas — bancos, industrias, logística e atendimento ao cliente. Muitas funções tradicionais desapareceram, forçando milhares de profissionais a buscar requalificação. Embora surjam empregos em áreas técnicas, o processo é desigual e pode acentuar problemas sociais. Grandes empresas ganham competitividade, mas governos e sociedade enfrentam o desafio de reminar a força de trabalho para a economia digital. Políticas públicas de inclusão tecnológica são urgentes para evitar que o progresso tecnológico exclua ainda mais quem já é vulnerável.

💬 5. Confusão entre IA e Apoio Emocional

O uso crescente de chatbots e assistentes com linguagem “empática” desafia as fronteiras do cuidado em saúde mental. Muitas pessoas recorrem a IAs para desabafar ou buscar orientações psicológicas, esquecendo que essas ferramentas não possuem empatia real nem olham para os contextos humanos de modo completo. Dependência desse tipo de suporte pode retardar tratamentos necessários, confundir diagnósticos ou perpetuar quadros de ansiedade e depressão. O uso de IA deve sempre ser complementar à escuta profissional. Alertar para os limites e riscos desse tipo de automação é essencial para proteger quem está mais vulnerável.

🌐 O impacto na privacidade dos dados e a vigilância em massa

Outro problema crescente é o uso de dados pessoais — muitas vezes sem transparência — para treinar e operar sistemas de IA. Empresas e governos utilizam IA para monitoramento, reconhecimento facial e análise comportamental, ampliando a vigilância em massa. Isso pode ajudar na segurança, mas também coloca em risco a privacidade de cidadãos, que ficam à mercê de abusos de poder e filtragem algorítmica. Casos recentes mostram como dados coletados sem critério alimentam práticas discriminatórias, interferem em eleições e mudam hábitos de consumo sem consentimento pleno dos usuários. Discussão sobre limites éticos e legais se torna urgente.

🧑⚖️ A responsabilidade legal e desafios em regulamentação

A evolução da IA desafia a legislação. De quem é a culpa se um algoritmo cometer erro médico, financeiro ou judicial? A opacidade de muitos modelos dificulta a responsabilização. Países como Estados Unidos, Brasil e União Europeia têm debatido leis para IA que assegurem auditoria, transparência e explicabilidade dos sistemas. Especialistas recomendam regulações que protejam o cidadão sem frear a inovação. A tendência é de crescimento da pressão por regras claras de rastreabilidade, diretrizes técnicas e punição de condutas ilícitas. Promover esse debate fortalece a confiança social e evita danos irreversíveis.

🗳️ Manipulação Eleitoral e Desinformação em Massa

A IA é um instrumento poderoso para criação e disseminação de notícias falsas em larga escala. Deepfakes e bots de redes sociais já foram usados para manipular eleições, distorcer debates públicos e polarizar grupos sociais. Algoritmos de recomendação fortalecem as chamadas bolhas de filtro, mostrando apenas o que reforça as crenças do usuário, dificultando o exercício do diálogo e do senso crítico. A sociedade precisa se educar para identificar fake news e exigir mais transparência das plataformas digitais, que também têm responsabilidade na regulação e na moderação do conteúdo.

🔒 Falta de Transparência: A “Caixa-Preta” da IA

Uma das maiores preocupações ao se utilizar IA é a dificuldade de entender os processos internos, pois muitos algoritmos de IA são verdadeiras caixas-pretas. Na prática, nem mesmo programadores conseguem explicar como certas decisões são tomadas. Essa opacidade pode causar erros graves, injustiças e dificultar a auditoria em áreas como saúde, finanças ou justiça. Pressionar empresas a adotar modelos mais transparentes e explicáveis é vital para garantir direitos, corrigir falhas e aumentar a confiança geral nas tecnologias desenvolvidas para a sociedade.

🚨 Um Alerta Final: Pense Antes de Confiar

A IA pode ajudar, mas jamais deve substituir o pensamento crítico e a responsabilidade individual e coletiva. Sempre questione resultados, duvide de conteúdos perfeitos demais e proteja suas informações. A tecnologia deve ser usada de forma ética, transparente e responsável. O bem-estar coletivo, a justiça social e a liberdade individual dependem das escolhas que fazemos ao construir e adotar novas ferramentas tecnológicas em escala global.

📝 Conclusão

A inteligência artificial é uma potência, mas seus riscos são reais e presentes. Ética, transparência, crítica e regulação são indispensáveis para enfrentar desafios como viés, manipulação, desemprego, privacidade e caixa-preta algorítmica. Somente assim a sociedade poderá garantir que a tecnologia esteja a serviço de todos e não do interesse de poucos. Debater, buscar informação e fiscalizar o uso da IA é tarefa contínua para construir um futuro inovador e justo para todos.

🔗 Links Úteis

- Como identificar Deepfakes e se proteger:

https://www.veriff.com/pt-br/verificacao-de-identidade/noticias/fraude-deepfake-em-tempo-real-em-2025-combatendo-os-golpes-impulsionados-por-ia - Guia ético sobre riscos da IA (Alura):

https://www.alura.com.br/empresas/artigos/riscos-da-ia

- Perplexity AI dá acesso gratuito ao Pro Search para estudantes em todo o mundo 🎓

- Gemini 2.5 Flash Image (Nano Banana): conheça o novo editor de imagens com IA da Google

- Workshop Prático: Demonstração de Ferramentas e Estratégias de IA para Professores

- 🍌 O Google deu uma Nano Banana para os concorrentes de criação de imagem

- Esqueça câmeras e edições: descubra como o Veo 3 cria vídeos realistas em minutos