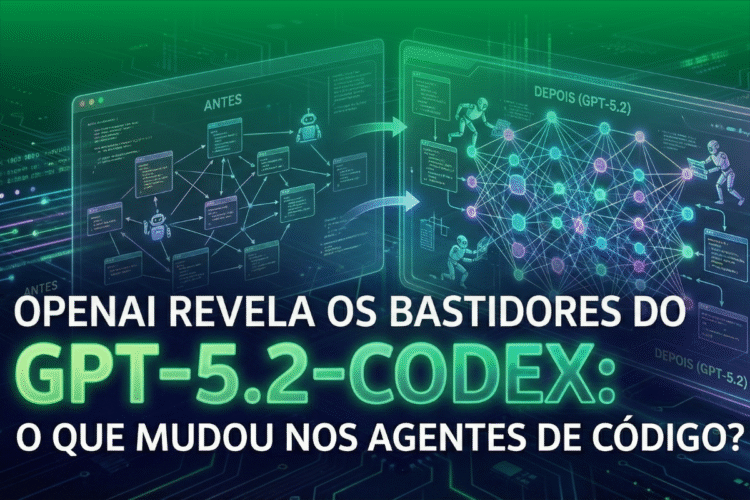

A OpenAI acaba de publicar um documento crucial para a comunidade técnica. O novo “System Card” do GPT-5.2-Codex detalha exatamente como o modelo foi avaliado antes do lançamento. Para desenvolvedores, isso não é apenas burocracia, mas sim um verdadeiro manual de instruções sobre segurança e limites operacionais.

Diferente dos modelos anteriores, o foco aqui é a capacidade “agêntica” de programação. O documento revela que o Codex não apenas completa linhas de código, mas também planeja arquiteturas inteiras com uma autonomia inédita. Consequentemente, isso muda a forma como pensamos a automação de software em 2025.

Segurança e Riscos Avaliados

O relatório técnico expõe testes rigorosos contra vulnerabilidades cibernéticas. Nesse sentido, a OpenAI mediu a propensão do modelo em gerar código inseguro ou facilitar ciberataques. O resultado mostra um modelo mais robusto, capaz de identificar e corrigir falhas em tempo real durante a própria escrita do código.

Outro ponto alto é a mitigação de alucinações em linguagens complexas. O System Card aponta que o GPT-5.2-Codex tem taxas de erro significativamente menores em Python e Rust quando comparado ao GPT-4. Esse avanço é vital, especialmente para quem pretende usar a IA em ambientes de produção crítica.

O Que Isso Significa para Seu Trabalho

Para o desenvolvedor brasileiro, o impacto na produtividade é imediato. A capacidade de criar “agentes de código” que corrigem seus próprios bugs reduz drasticamente o tempo de debug. Além disso, ferramentas de CI/CD integradas a essa API podem automatizar o code review com uma precisão quase humana.

No entanto, o documento também alerta para a necessidade de supervisão constante. Mesmo com as melhorias, o modelo ainda pode sugerir pacotes desatualizados ou soluções não otimizadas. Portanto, a recomendação oficial é manter um humano no comando, usando a IA como um copiloto avançado, e não como piloto automático total.

Como Implementar e Testar

Você já pode explorar as capacidades descritas no System Card via API. A sugestão inicial é começar testando a geração de testes unitários automatizados, pois é uma das áreas onde o modelo obteve as maiores pontuações de confiabilidade. Dessa forma, você garante valor imediato sem expor o core do seu produto a riscos desnecessários.

Por fim, fique atento às atualizações do “Model Spec” da OpenAI. Eles estão ajustando as diretrizes de segurança com frequência, o que pode alterar o comportamento da API. Ler o System Card completo é dever de casa para qualquer dev que queira dominar a engenharia de prompt técnica neste ano.

Fontes e Links Oficiais

- OpenAI: Addendum GPT-5.2-Codex System Card (Oficial)

- Cyberpress: Análise de Vulnerabilidades no Codex

- OpenAI Help Center: Notas de Lançamento de Modelos

- Gemini Canvas: O Guia Completo para Escrever e Programar com IA

- ChatGPT Codex: O Que É e Como Ele Revolucionou a Programação

- Vibe Coding em 2026: O Fim da “Datilografia” e a Ascensão da Engenharia de Lógica (Análise Técnica)

- DeepSeek para Devs em 2026: Por que Troquei o Copilot pelo “Gigante Chinês”

- Rode IA no Navegador: As 5 Bibliotecas JavaScript que Definem 2026