O ano de 2025 marcou uma virada técnica decisiva: o suporte total ao WebGPU em todos os principais navegadores. Agora, em janeiro de 2026, a IA no navegador deixou de ser um “experimento” curioso para se tornar uma arquitetura robusta. Hoje, é possível rodar modelos complexos diretamente no dispositivo do usuário, sem depender de servidores caros na nuvem.

Para começar, é fundamental entender a mudança econômica. Executar inferência no client-side (lado do cliente) elimina o custo por token que antes sangrava o orçamento de startups e grandes empresas. Além disso, a latência de rede desaparece, criando interações instantâneas que parecem mágica para o usuário final.

Nesse cenário, o navegador se transformou no novo sistema operacional para IA. Se você é desenvolvedor ou decisor técnico, ignorar essa pilha tecnológica em 2026 é perder a vantagem competitiva da privacidade e da performance.

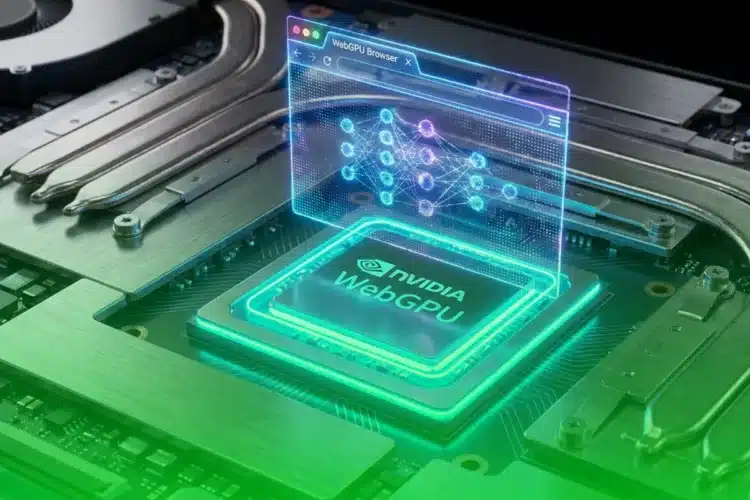

O Novo Motor: WebGPU e WASM

Primeiramente, precisamos destacar o “motor” que torna tudo isso possível. O WebGL, que serviu bem por anos, tornou-se obsoleto para as demandas de computação pesada das redes neurais modernas. O WebGPU chegou para desbloquear o acesso direto à GPU do usuário, oferecendo um ganho de performance na inferência que pode ser de 3x a 10x superior em comparação às tecnologias anteriores.

Em seguida, temos o papel do WebAssembly (WASM). Ele permite que códigos escritos em linguagens de baixo nível, como C++ ou Rust, rodem no navegador com velocidade quase nativa. Em 2026, a combinação de WASM para a lógica e WebGPU para o cálculo paralelo é o padrão ouro para aplicações web de alta performance.

As “Big Three”: Bibliotecas Essenciais em 2026

1. Transformers.js v3 (A Líder de Mercado)

Atualmente, esta é a biblioteca mais impactante do ecossistema JavaScript. A versão v3, consolidada no final de 2025, trouxe suporte nativo e estável ao WebGPU, permitindo executar modelos de linguagem (LLMs) e visão computacional diretamente no browser.

Vale destacar que a Transformers.js democratizou o acesso aos SLMs (Small Language Models). Modelos quantizados, como versões otimizadas do Llama-3 ou Phi-3, agora rodam em laptops convencionais sem engasgos, permitindo funcionalidades de “bordo” como resumo de texto e análise de sentimento sem enviar um único byte para a nuvem.

2. ONNX Runtime Web

Por outro lado, para equipes que treinam modelos personalizados em PyTorch ou TensorFlow, o ONNX Runtime Web continua sendo a ponte universal. Ele permite exportar modelos treinados em Python para o formato .onnx e executá-los em qualquer ambiente JavaScript com aceleração de hardware automática.

Isso significa que você não fica preso a um framework específico. A flexibilidade do ONNX o torna a escolha preferida para aplicações corporativas que precisam garantir compatibilidade entre diferentes dispositivos e navegadores em 2026.

3. TensorFlow.js (O Veterano Resiliente)

Apesar da ascensão de novas ferramentas, o TensorFlow.js mantém seu reinado em nichos específicos. Ele ainda é imbatível para retreino de modelos simples diretamente no navegador (Transfer Learning) e possui uma comunidade vasta com milhares de modelos pré-treinados prontos para uso, como detecção de pose e segmentação de imagem.

Casos de Uso Reais: Além do Hype

Privacidade e Compliance (GDPR/LGPD)

Principalmente em setores regulados, como saúde e finanças, a IA no navegador é um divisor de águas. Como os dados nunca saem do dispositivo do usuário, o compliance com leis de proteção de dados é garantido por design. Um app médico pode analisar exames preliminares localmente, sem risco de vazamento de dados sensíveis na nuvem.

Edição de Mídia em Tempo Real

Da mesma forma, ferramentas de criação de conteúdo explodiram em 2026. Imagine remover o fundo de um vídeo em 4K ou aplicar filtros de estilo neural em tempo real, dentro de uma aba do Chrome, sem upload de arquivos gigantes. Isso só é viável graças à baixa latência do processamento local via Web Media API Snapshot e WebGPU.

Desafios que Ainda Persistem

No entanto, nem tudo está resolvido. O maior obstáculo continua sendo o “cold start”: o download inicial dos modelos. Mesmo quantizados, modelos úteis podem pesar de 50MB a centenas de megabytes, o que exige estratégias inteligentes de caching e carregamento progressivo para não frustrar o usuário em conexões móveis.

Além disso, o consumo de bateria é uma preocupação real. Rodar modelos de IA exige muito do hardware, e desenvolvedores precisam implementar limitadores para garantir que seus web apps não drenem a energia de smartphones e laptops em poucos minutos.

Conclusão

Portanto, investir em IA no navegador não é apenas uma tendência passageira, mas uma evolução necessária da arquitetura web. Em 2026, as ferramentas já estão maduras: WebGPU é padrão, Transformers.js simplificou a implementação e o hardware dos usuários nunca foi tão potente.

Se você deseja reduzir custos de infraestrutura e oferecer uma experiência de usuário superior, o momento de reescrever seu stack frontend é agora. Não espere 2027 para aprender o que seus concorrentes já estão implementando hoje.

Quer dominar essa tecnologia? Inscreva-se na nossa newsletter técnica e receba, na próxima semana, um tutorial prático de como implementar seu primeiro modelo de IA com Transformers.js.

Fontes e Referências

- WebGPU is now supported in major browsers | Web.dev

- Transformers.js v3: WebGPU Support & New Models | Hugging Face

- How To Add Real-Time AI Reasoning to Your JS Apps | Dev.to

- The State of WebAssembly – 2024 and 2025 | Uno Platform

- JavaScript Frameworks – Heading into 2026 | This is Learning

Leitura Recomendada

- Gemini Canvas: O Guia Completo para Escrever e Programar com IA

- ChatGPT Codex: O Que É e Como Ele Revolucionou a Programação

- Vibe Coding em 2026: O Fim da “Datilografia” e a Ascensão da Engenharia de Lógica (Análise Técnica)

- DeepSeek para Devs em 2026: Por que Troquei o Copilot pelo “Gigante Chinês”

- Rode IA no Navegador: As 5 Bibliotecas JavaScript que Definem 2026